- 機器學習基礎

- ML - 首頁

- ML - 簡介

- ML - 入門

- ML - 基本概念

- ML - 生態系統

- ML - Python 庫

- ML - 應用

- ML - 生命週期

- ML -所需技能

- ML - 實現

- ML - 挑戰與常見問題

- ML - 侷限性

- ML - 真實案例

- ML - 資料結構

- ML - 數學基礎

- ML - 人工智慧

- ML - 神經網路

- ML - 深度學習

- ML - 獲取資料集

- ML - 分類資料

- ML - 資料載入

- ML - 資料理解

- ML - 資料準備

- ML - 模型

- ML - 監督學習

- ML - 無監督學習

- ML - 半監督學習

- ML - 強化學習

- ML - 監督學習 vs. 無監督學習

- 機器學習資料視覺化

- ML - 資料視覺化

- ML - 直方圖

- ML - 密度圖

- ML - 箱線圖

- ML - 相關矩陣圖

- ML - 散點矩陣圖

- 機器學習統計學

- ML - 統計學

- ML - 均值、中位數、眾數

- ML - 標準差

- ML - 百分位數

- ML - 資料分佈

- ML - 偏度和峰度

- ML - 偏差和方差

- ML - 假設

- ML中的迴歸分析

- ML - 迴歸分析

- ML - 線性迴歸

- ML - 簡單線性迴歸

- ML - 多元線性迴歸

- ML - 多項式迴歸

- ML中的分類演算法

- ML - 分類演算法

- ML - 邏輯迴歸

- ML - K近鄰演算法 (KNN)

- ML - 樸素貝葉斯演算法

- ML - 決策樹演算法

- ML - 支援向量機

- ML - 隨機森林

- ML - 混淆矩陣

- ML - 隨機梯度下降

- ML中的聚類演算法

- ML - 聚類演算法

- ML - 基於質心的聚類

- ML - K均值聚類

- ML - K中心點聚類

- ML - 均值漂移聚類

- ML - 層次聚類

- ML - 基於密度的聚類

- ML - DBSCAN聚類

- ML - OPTICS聚類

- ML - HDBSCAN聚類

- ML - BIRCH聚類

- ML - 親和傳播

- ML - 基於分佈的聚類

- ML - 凝聚層次聚類

- ML中的降維

- ML - 降維

- ML - 特徵選擇

- ML - 特徵提取

- ML - 向後逐步迴歸

- ML - 向前特徵構造

- ML - 高相關性過濾

- ML - 低方差過濾

- ML - 缺失值比例

- ML - 主成分分析

- 強化學習

- ML - 強化學習演算法

- ML - 利用與探索

- ML - Q學習

- ML - REINFORCE演算法

- ML - SARSA強化學習

- ML - 演員-評論家方法

- 深度強化學習

- ML - 深度強化學習

- 量子機器學習

- ML - 量子機器學習

- ML - 使用Python的量子機器學習

- 機器學習雜項

- ML - 效能指標

- ML - 自動工作流

- ML - 提升模型效能

- ML - 梯度提升

- ML - 自舉匯聚 (Bagging)

- ML - 交叉驗證

- ML - AUC-ROC曲線

- ML - 網格搜尋

- ML - 資料縮放

- ML - 訓練和測試

- ML - 關聯規則

- ML - Apriori演算法

- ML - 高斯判別分析

- ML - 成本函式

- ML - 貝葉斯定理

- ML - 精度和召回率

- ML - 對抗性

- ML - 堆疊

- ML - 時期

- ML - 感知器

- ML - 正則化

- ML - 過擬合

- ML - P值

- ML - 熵

- ML - MLOps

- ML - 資料洩露

- ML - 機器學習的商業化

- ML - 資料型別

- 機器學習 - 資源

- ML - 快速指南

- ML - 速查表

- ML - 面試問題

- ML - 有用資源

- ML - 討論

監督式機器學習

什麼是監督式機器學習?

監督學習,也稱為監督式機器學習,是一種使用標記資料集訓練模型以預測結果的機器學習型別。標記資料集是指包含輸入資料(特徵)及其對應的輸出資料(目標)的資料集。

監督學習演算法的主要目標是在執行多個訓練資料例項後,學習輸入資料樣本和相應輸出之間的關聯。

監督學習是如何工作的?

在監督式機器學習中,模型使用包含輸入-輸出對的資料集進行訓練。

監督學習演算法分析資料集並學習輸入資料(特徵)和正確輸出(標籤/目標)之間的關係。在訓練過程中,模型透過最小化損失函式來估計算法的引數。損失函式衡量模型預測值與實際目標值之間的差異。

模型迭代地更新其引數,直到損失/誤差被充分最小化。

訓練完成後,模型引數將具有最佳值。模型已經學習到輸入和目標之間的最佳對映/關係。現在,模型可以預測新的和未見過的輸入資料的數值。

監督學習演算法的型別

監督式機器學習分為兩種型別的任務:分類和迴歸。

1. 分類

基於分類的任務的關鍵目標是預測給定輸入資料的類別輸出標籤或響應,例如真假、男女、是或否等。眾所周知,類別輸出響應意味著無序和離散的值;因此,每個輸出響應都屬於一個特定的類別或範疇。

一些流行的分類演算法包括決策樹、隨機森林、支援向量機 (SVM)、邏輯迴歸等。

2. 迴歸

基於迴歸的任務的關鍵目標是預測輸出標籤或響應,這些響應是給定輸入資料的連續數值。基本上,迴歸模型使用輸入資料特徵(自變數)及其對應的連續數值輸出值(因變數或結果變數)來學習輸入和相應輸出之間的特定關聯。

一些流行的迴歸演算法包括線性迴歸、多項式迴歸、Lasso迴歸等。

監督學習的演算法

監督學習是機器學習中重要的模型之一。本章將詳細討論它。

監督學習有多種演算法。一些廣泛使用的監督學習演算法如下所示:

讓我們詳細討論上述每種監督式機器學習演算法。

1. 線性迴歸

線性迴歸 是一種試圖找到輸入特徵和輸出值之間線性關係以預測未來事件的演算法。該演算法廣泛用於進行股票分析、天氣預報等。

2. K近鄰演算法

K近鄰演算法 (kNN) 是一種統計技術,可用於解決分類和迴歸問題。該演算法透過數學計算與訓練資料中其他點的最近距離來對新資料進行分類或預測值。

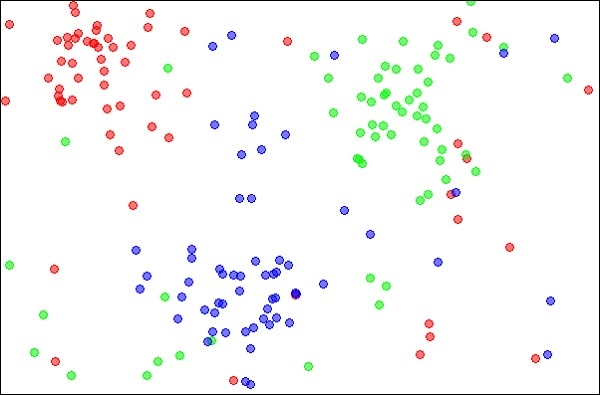

讓我們討論一下使用kNN對未知物體進行分類的情況。考慮如下所示的物體分佈圖:

來源

https://en.wikipedia.org/wiki/K-nearest_neighbors_algorithm

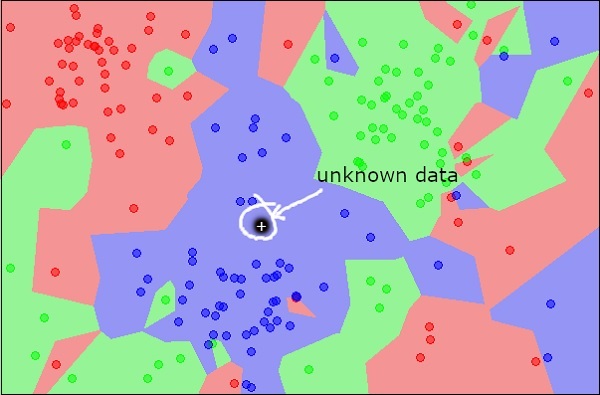

該圖顯示了三種類型的物體,分別用紅色、藍色和綠色標記。當您在上述資料集上執行kNN分類器時,每種型別的物體的邊界將如下所示:

來源

https://en.wikipedia.org/wiki/K-nearest_neighbors_algorithm

現在,考慮一個您想要將其分類為紅色、綠色或藍色的新未知物體。這在下面的圖中有所描述。

從視覺上看,未知資料點屬於藍色物體的類別。數學上,可以透過測量該未知點與資料集中每個其他點的距離來得出這個結論。當您這樣做時,您會知道它的許多鄰居都是藍色的。紅色和綠色物體之間的平均距離肯定大於藍色物體之間的平均距離。因此,這個未知物體可以被分類為屬於藍色類別。

kNN演算法也可用於迴歸問題。kNN演算法在大多數ML庫中都以現成的形式提供。

3. 決策樹

決策樹 是一種樹狀結構,用於決策和分析可能的結果。該演算法根據特徵將資料分割成子集,其中每個父節點表示內部決策,葉節點表示最終預測。

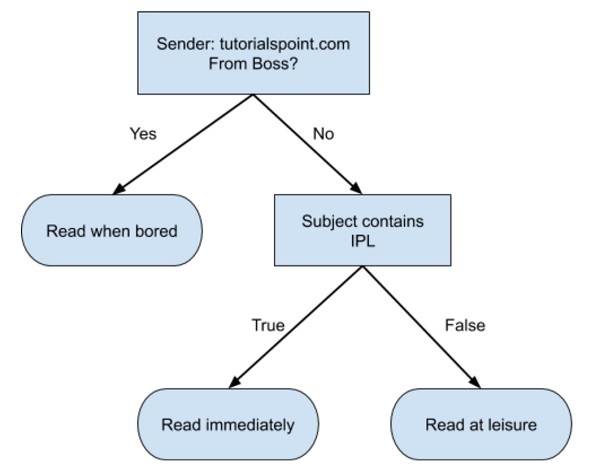

一個簡單的流程圖格式的決策樹如下所示:

您可以編寫程式碼根據此流程圖對輸入資料進行分類。流程圖不言自明且簡單。在這種情況下,您正在嘗試對收到的電子郵件進行分類,以決定何時閱讀它。

實際上,決策樹可能很大且很複雜。有多種演算法可用於建立和遍歷這些樹。作為一名機器學習愛好者,您需要理解和掌握建立和遍歷決策樹的技術。

4. 樸素貝葉斯

樸素貝葉斯 用於建立分類器。假設您想從一個水果籃中分類(分類)不同種類的水果。您可以使用水果的顏色、大小和形狀等特徵;例如,任何顏色為紅色、形狀為圓形且直徑約為 10 釐米的水果都可以被認為是蘋果。因此,為了訓練模型,您將使用這些特徵並測試給定特徵匹配所需約束的機率。然後將不同特徵的機率結合起來,得出給定水果是蘋果的機率。樸素貝葉斯通常只需要少量訓練資料即可進行分類。

5. 邏輯迴歸

邏輯迴歸 是一種統計算法,用於估計事件發生的機率。

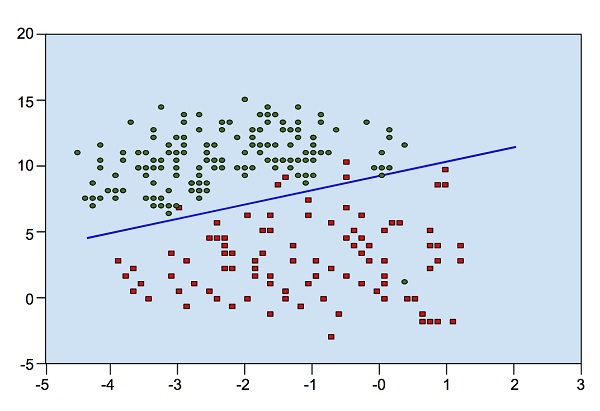

看下面的圖表。它顯示了XY平面中資料點的分佈。

從圖中,我們可以直觀地檢查紅色和綠色點的分離。您可以畫一條邊界線來區分這些點。現在,要對新的資料點進行分類,您只需要確定該點位於線的哪一側。

6. 支援向量機

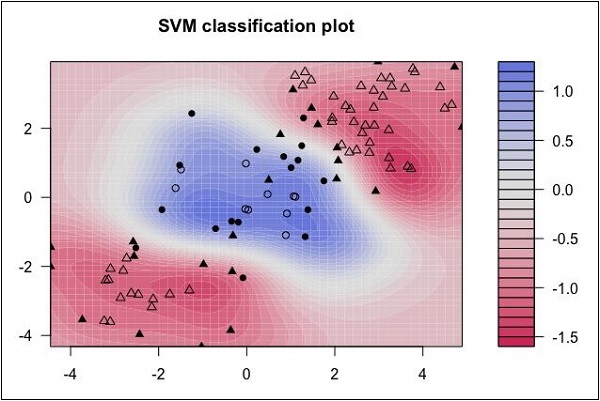

支援向量機 (SVM) 演算法通常可用於分類和迴歸。對於分類任務,該演算法建立一個超平面來將資料分成不同的類別。而對於迴歸,該演算法則嘗試擬合一條誤差最小的迴歸線。

請看以下資料分佈。這裡的三類資料無法線性分離。邊界曲線是非線性的。在這種情況下,找到曲線的方程就變得非常複雜。

支援向量機 (SVM) 在確定此類情況下的分離邊界方面非常有用。

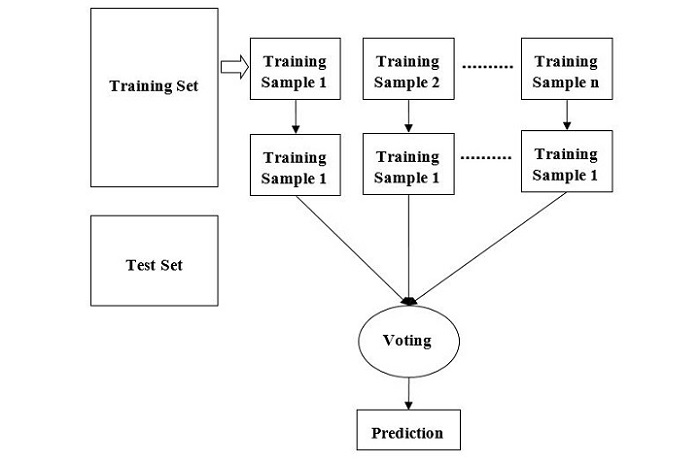

7. 隨機森林

隨機森林 也是一種監督學習演算法,它靈活適用於分類和迴歸。該演算法結合了多個決策樹,並將其合併以提高預測的準確性。

下圖說明了隨機森林演算法的工作原理:

8. 梯度提升

梯度提升 將弱學習器(決策樹)組合起來,建立一個強大的模型。它構建新的模型來糾正先前模型的錯誤。該演算法的目標是最小化損失函式。它可以有效地用於分類和迴歸任務。

監督學習的優勢

監督學習演算法是機器學習模型中最流行的一種。一些好處包括:

- 監督學習的目標定義明確,這提高了預測的準確性。

- 使用監督學習訓練的模型在預測和分類方面非常有效,因為它們使用標記資料集。

- 它具有高度的通用性,即可以應用於各種問題,例如垃圾郵件檢測、股票價格等。

監督學習的劣勢

儘管監督學習是最常用的,但它也面臨一些挑戰。其中一些是:

- 監督學習需要大量的標記資料才能有效地訓練模型。收集如此龐大的資料實際上非常困難;它既昂貴又費時。

- 如果測試資料與訓練資料不同,監督學習無法準確預測。

- 準確標記資料很複雜,需要專業知識和努力。

監督學習的應用

監督學習模型廣泛應用於各個行業的許多應用中,包括以下方面:

- **影像識別** - 模型在標記的影像資料集上進行訓練,其中每個影像都與一個標籤相關聯。模型被輸入資料,這允許它學習模式和特徵。一旦訓練完成,現在可以使用新的、未見過的資料來測試模型。這廣泛用於人臉識別和目標檢測等應用中。

- **預測分析** - 監督學習演算法用於訓練標記的歷史資料,允許模型學習輸入特徵和輸出之間的模式和關係,以識別趨勢並做出準確的預測。企業使用這種方法來做出資料驅動的決策並增強戰略規劃。