- 機器學習基礎

- ML - 首頁

- ML - 簡介

- ML - 入門

- ML - 基本概念

- ML - 生態系統

- ML - Python 庫

- ML - 應用

- ML - 生命週期

- ML - 必備技能

- ML - 實現

- ML - 挑戰與常見問題

- ML - 限制

- ML - 現實生活中的例子

- ML - 資料結構

- ML - 數學

- ML - 人工智慧

- ML - 神經網路

- ML - 深度學習

- ML - 獲取資料集

- ML - 分類資料

- ML - 資料載入

- ML - 資料理解

- ML - 資料準備

- ML - 模型

- ML - 監督學習

- ML - 無監督學習

- ML - 半監督學習

- ML - 強化學習

- ML - 監督學習與無監督學習

- 機器學習資料視覺化

- ML - 資料視覺化

- ML - 直方圖

- ML - 密度圖

- ML - 箱線圖

- ML - 相關矩陣圖

- ML - 散點矩陣圖

- 機器學習統計學

- ML - 統計學

- ML - 均值、中位數、眾數

- ML - 標準差

- ML - 百分位數

- ML - 資料分佈

- ML - 偏度和峰度

- ML - 偏差和方差

- ML - 假設

- 機器學習中的迴歸分析

- ML - 迴歸分析

- ML - 線性迴歸

- ML - 簡單線性迴歸

- ML - 多元線性迴歸

- ML - 多項式迴歸

- 機器學習中的分類演算法

- ML - 分類演算法

- ML - 邏輯迴歸

- ML - K近鄰演算法 (KNN)

- ML - 樸素貝葉斯演算法

- ML - 決策樹演算法

- ML - 支援向量機

- ML - 隨機森林

- ML - 混淆矩陣

- ML - 隨機梯度下降

- 機器學習中的聚類演算法

- ML - 聚類演算法

- ML - 基於中心點的聚類

- ML - K均值聚類

- ML - K中心點聚類

- ML - 均值漂移聚類

- ML - 層次聚類

- ML - 基於密度的聚類

- ML - DBSCAN 聚類

- ML - OPTICS 聚類

- ML - HDBSCAN 聚類

- ML - BIRCH 聚類

- ML - 親和傳播

- ML - 基於分佈的聚類

- ML - 聚合聚類

- 機器學習中的降維

- ML - 降維

- ML - 特徵選擇

- ML - 特徵提取

- ML - 後退消除法

- ML - 前向特徵構造

- ML - 高相關性過濾器

- ML - 低方差過濾器

- ML - 缺失值比率

- ML - 主成分分析

- 強化學習

- ML - 強化學習演算法

- ML - 利用與探索

- ML - Q學習

- ML - REINFORCE 演算法

- ML - SARSA 強化學習

- ML - 演員-評論家方法

- 深度強化學習

- ML - 深度強化學習

- 量子機器學習

- ML - 量子機器學習

- ML - 使用 Python 的量子機器學習

- 機器學習雜項

- ML - 效能指標

- ML - 自動工作流程

- ML - 提升模型效能

- ML - 梯度提升

- ML - 自舉匯聚 (Bagging)

- ML - 交叉驗證

- ML - AUC-ROC 曲線

- ML - 網格搜尋

- ML - 資料縮放

- ML - 訓練和測試

- ML - 關聯規則

- ML - Apriori 演算法

- ML - 高斯判別分析

- ML - 成本函式

- ML - 貝葉斯定理

- ML - 精度和召回率

- ML - 對抗性

- ML - 堆疊

- ML - 輪次

- ML - 感知器

- ML - 正則化

- ML - 過擬合

- ML - P值

- ML - 熵

- ML - MLOps

- ML - 資料洩露

- ML - 機器學習的貨幣化

- ML - 資料型別

- 機器學習 - 資源

- ML - 快速指南

- ML - 速查表

- ML - 面試問題

- ML - 有用資源

- ML - 討論

機器學習速查表

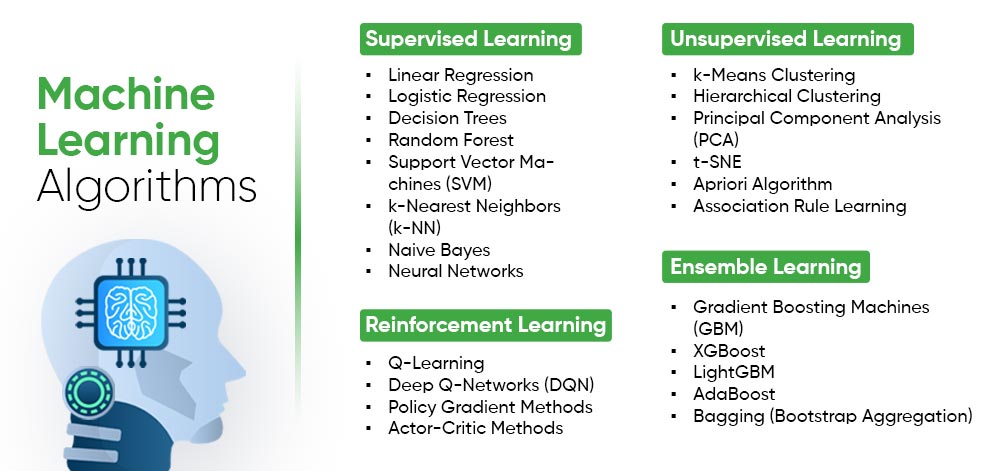

這份**機器學習速查表**作為機器學習關鍵概念和常用演算法的快速參考指南。它包括監督學習、無監督學習和強化學習等重要主題,以及線性迴歸和決策樹等常用演算法。這份**機器學習 (ML) 速查表**對任何對機器學習感興趣的人都有價值。

目錄

監督機器學習

監督機器學習是一種機器學習型別,它使用標記資料集訓練演算法以預測結果。

監督學習的主要目標是在執行多個訓練資料例項後,使演算法學習輸入資料樣本和相應輸出之間的關聯。

監督機器學習演算法

監督學習演算法分為兩種型別的任務——分類和迴歸。下面,我們列出了常用的監督機器學習演算法、它們的應用、優點和缺點。

| 演算法 | 描述 | 應用 | 優點 | 缺點 |

|---|---|---|---|---|

| 線性迴歸 | 基於輸入和輸出變數之間的線性關係預測連續數值。 | 預測房價、股票價格、銷售額。 | 易於實現、可解釋、高效。 | 對異常值敏感,假設線性關係。 |

| 邏輯迴歸 | 使用邏輯函式預測分類值(例如,二元分類)。 | 將電子郵件分類為垃圾郵件或非垃圾郵件,預測客戶流失。 | 可解釋、高效、可以處理分類特徵。 | 容易過擬合,僅限於線性關係。 |

| 嶺迴歸 | 正則化線性迴歸,在損失函式中新增懲罰項以防止過擬合。 | 迴歸任務,特徵選擇。 | 可以處理多重共線性,提高模型泛化能力。 | 需要調整正則化引數。 |

| 套索迴歸 | 正則化線性迴歸,在損失函式中新增懲罰項以鼓勵稀疏性(特徵選擇)。 | 迴歸任務,特徵選擇。 | 可以處理多重共線性,執行特徵選擇。 | 可能會在特徵選擇中引入偏差。 |

| K近鄰演算法 (KNN) | 根據訓練資料集中其 k 個最近鄰的大多數類別或平均值對新資料點的類別或值進行分類或預測。 | 分類、迴歸、推薦系統。 | 易於實現,不需要訓練階段,可以處理非線性關係。 | 對於大型資料集來說,計算成本可能很高,對距離度量和 k 值的選擇敏感。 |

| 支援向量機 (SVMs) | 找到最佳超平面將資料點分成不同的類別。 | 影像分類、文字分類、異常檢測。 | 對於高維資料有效,使用核心處理非線性關係。 | 對於大型資料集來說,計算成本可能很高,對異常值敏感。 |

| 決策樹 | 建立一個樹狀模型,根據一系列規則做出決策。 | 分類、迴歸、預測建模。 | 易於理解和解釋,可以處理數值和分類特徵。 | 容易過擬合,對資料的小變化敏感。 |

| 隨機森林 | 決策樹的集合,結合多個模型以提高準確性和減少過擬合。 | 分類、迴歸、預測建模。 | 比單個決策樹更準確,對噪聲和異常值具有魯棒性。 | 對於大型資料集來說,計算成本可能很高。 |

| 樸素貝葉斯 | 基於貝葉斯定理的機率分類器,假設特徵獨立。 | 文字分類、垃圾郵件過濾、情感分析。 | 易於實現、高效、可以處理分類和數值特徵。 | 假設特徵獨立,這可能並不總是正確的。 |

| 梯度提升迴歸 | 一種整合方法,迭代訓練弱模型以提高準確性。 | 迴歸、分類、預測建模。 | 高度準確,可以處理複雜的關係。 | 計算成本可能很高,需要仔細調整超引數。 |

| XGBoost | 一個可擴充套件且高效的梯度提升框架。 | 迴歸、分類、排序。 | 高度準確、高效、可以處理大型資料集。 | 配置可能很複雜。 |

| LightGBM 迴歸器 | 一個梯度提升框架,使用直方圖和梯度提升進行高效訓練。 | 迴歸、分類、排序。 | 比 XGBoost 更快,對於大型資料集高效。 | 在某些情況下,準確性可能略低於 XGBoost。 |

| 神經網路 (深度學習) | 具有多層的複雜模型,能夠學習複雜的模式和關係。 | 影像分類、自然語言處理、語音識別。 | 高度準確,可以處理複雜的任務。 | 計算成本可能很高,需要仔細調整超引數。 |

無監督機器學習

無監督機器學習是一種機器學習型別,它在沒有人工監督的情況下學習資料中的模式和結構。無監督學習使用機器學習演算法分析資料並在未標記的資料集中發現潛在的模式。

無監督機器學習演算法

無監督學習演算法分為三類——聚類、關聯和降維。下面,我們列出了常用的無監督機器學習演算法、它們的應用、優點和缺點。

| 演算法 | 描述 | 應用 | 優點 | 缺點 |

|---|---|---|---|---|

| K均值聚類 | 根據相似性將資料劃分為 K 個簇。 | 客戶細分、影像分割、異常檢測。 | 易於實現、高效、可以處理大型資料集。 | 需要指定聚類數量,對初始化敏感。 |

| 層次聚類 | 建立聚類的層次結構,可以是凝聚的(自下而上)或分裂的(自上而下)。 | 客戶細分、影像分割、異常值檢測。 | 可以揭示層次結構,不需要指定聚類數量。 | 對於大型資料集,計算成本可能很高,對距離度量敏感。 |

| 主成分分析 (PCA) | 在保留最重要特徵的同時降低資料的維度。 | 資料視覺化、特徵工程、降噪。 | 高效,可以揭示資料中的潛在模式。 | 在降維過程中可能會丟失一些資訊。 |

| 奇異值分解 (SVD) | 將矩陣分解為其奇異值和向量。 | 資料分析、推薦系統、影像壓縮。 | 可用於降維和特徵提取。 | 對於大型矩陣,計算成本可能很高。 |

| 獨立成分分析 (ICA) | 從混合觀測中識別訊號的獨立來源。 | 盲源分離、訊號處理。 | 可以分離混合訊號,在語音識別等應用中很有用。 | 可能對初始化和關於源獨立性的假設敏感。 |

| 高斯混合模型 (GMM) | 將資料建模為高斯分佈的混合,假設每個聚類都是由高斯分佈生成的。 | 聚類、密度估計、異常檢測。 | 可以處理複雜的資料分佈,靈活。 | 計算成本可能很高,對初始化敏感。 |

| Apriori 演算法 | 一種頻繁項集挖掘演算法,用於發現數據集中項之間的關聯。 | 市場籃子分析、推薦系統。 | 有效地查詢頻繁項集,可用於關聯規則挖掘。 | 可能不適用於具有許多專案的龐大資料集。 |

| t-SNE | 一種非線性降維技術,保留區域性結構。 | 資料視覺化、聚類、異常檢測。 | 有效地將高維資料視覺化在低維空間中。 | 計算成本可能很高,對引數敏感。 |

| UMAP | 另一種非線性降維技術,保留全域性結構和區域性關係。 | 資料視覺化、聚類、異常檢測。 | 通常比 t-SNE 更快且更具可擴充套件性,很好地保留了全域性結構。 | 可能需要仔細調整引數。 |

強化學習

強化學習是一種機器學習型別,其中代理(通常是軟體實體)透過執行操作和監控結果來訓練以解釋環境。對於每個好的動作,代理都會獲得積極的反饋,對於每個壞的動作,代理都會獲得負面的反饋。它受到動物從經驗中學習的啟發,根據其行動的後果做出決策。

強化學習演算法

在本節中,我們列出了一些知名的強化學習演算法、其應用、優點和缺點。

| 演算法 | 描述 | 應用 | 優點 | 缺點 |

|---|---|---|---|---|

| Q 學習 | 一種離策略學習演算法,學習最優動作值函式。 | 遊戲博弈、機器人技術、控制系統。 | 易於實現,可以處理複雜的環境。 | 對於大型狀態空間,計算成本可能很高。 |

| SARSA | 一種線上策略學習演算法,根據當前策略更新動作值函式。 | 遊戲博弈、機器人技術、控制系統。 | 可以處理連續動作空間,適用於線上學習。 | 可能對探索-利用權衡敏感。 |

| 深度 Q 網路 (DQN) | 將深度學習與 Q 學習相結合,使用神經網路來逼近動作值函式。 | 雅達利遊戲博弈、機器人技術、自動駕駛汽車。 | 可以處理具有大型狀態和動作空間的複雜環境。 | 需要仔細調整超引數,計算成本可能很高。 |

| 策略梯度 | 直接最佳化策略函式以最大化獎勵。 | 機器人技術、遊戲博弈、自然語言處理。 | 可以處理連續動作空間,可能比基於值的的方法更有效率。 | 可能對噪聲和不穩定性敏感。 |

| 行動者-評論家 | 結合基於策略和基於值的方法,同時使用策略函式和值函式。 | 機器人技術、遊戲博弈、自然語言處理。 | 可能比純基於策略或基於值的方法更穩定和高效。 | 需要仔細平衡探索和利用。 |

| 非同步優勢行動者-評論家 (A3C) | 行動者-評論家的並行版本,可以處理具有大型狀態空間的複雜環境。 | 機器人技術、遊戲博弈、自然語言處理。 | 可能比傳統的行動者-評論家方法更有效率,適用於分散式訓練。 | 實現起來可能很複雜。 |

廣告