- 生成式AI教程

- 生成式AI - 首頁

- 生成式AI基礎

- 生成式AI基礎

- 生成式AI發展

- 機器學習與生成式AI

- 生成式AI模型

- 判別式模型與生成式模型

- 生成式AI模型型別

- 機率分佈

- 機率密度函式

- 最大似然估計

- 生成式AI網路

- GAN的工作原理?

- GAN架構

- 條件GAN

- StyleGAN和CycleGAN

- 訓練GAN

- GAN應用

- 生成式AI Transformer

- Transformer在生成式AI中的應用

- Transformer在生成式AI中的架構

- Transformer中的輸入嵌入

- 多頭注意力機制

- 位置編碼

- 前饋神經網路

- Transformer中的殘差連線

- 生成式AI自編碼器

- 自編碼器在生成式AI中的應用

- 自編碼器型別及應用

- 使用Python實現自編碼器

- 變分自編碼器

- 生成式AI和ChatGPT

- 一個生成式AI模型

- 生成式AI雜項

- 生成式AI在製造業中的應用

- 生成式AI在開發人員中的應用

- 生成式AI在網路安全中的應用

- 生成式AI在軟體測試中的應用

- 生成式AI在市場營銷中的應用

- 生成式AI在教育領域的應用

- 生成式AI在醫療保健領域的應用

- 生成式AI在學生中的應用

- 生成式AI在工業中的應用

- 生成式AI在電影製作中的應用

- 生成式AI在音樂創作中的應用

- 生成式AI在烹飪中的應用

- 生成式AI在媒體領域的應用

- 生成式AI在通訊領域的應用

- 生成式AI在攝影領域的應用

- 生成式AI資源

- 生成式AI - 有用資源

- 生成式AI - 討論

CycleGAN和StyleGAN

閱讀本章以瞭解CycleGAN和StyleGAN,以及它們在生成和轉換影像方面的卓越能力。

什麼是迴圈生成對抗網路?

CycleGAN,簡稱迴圈一致生成對抗網路,是一種旨在將一個影像的特徵轉移到另一個影像的GAN框架。換句話說,CycleGAN設計用於非配對影像到影像的轉換任務,其中輸入和輸出影像之間沒有關係。

與需要配對訓練資料的傳統GAN相比,CycleGAN可以在沒有任何監督的情況下學習兩個不同領域之間的對映。

CycleGAN如何工作?

CycleGAN的工作原理在於它將問題視為影像重建問題。讓我們瞭解它是如何工作的:

- CycleGAN首先獲取一個影像輸入,例如“X”。然後,它使用生成器,例如“G”,將輸入影像轉換為重建影像。

- 重建完成後,它藉助另一個生成器,例如“F”,將重建影像反向轉換為原始影像。

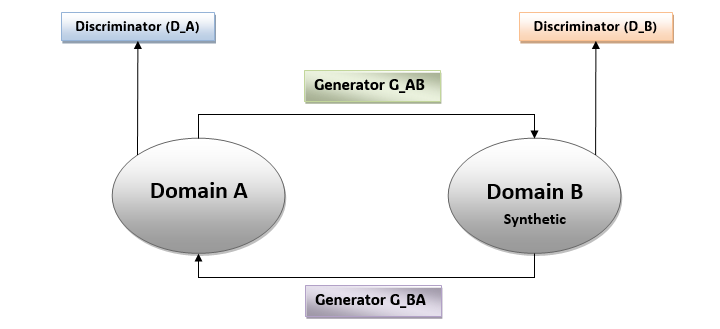

CycleGAN的架構

與傳統的GAN一樣,CycleGAN也包含兩個部分——生成器和判別器。但除了這兩個元件之外,CycleGAN還引入了迴圈一致性的概念。讓我們詳細瞭解CycleGAN的這些元件:

生成器網路 (G_AB 和 G_BA)

CycleGAN有兩個生成器網路,例如G_AB和G_BA。這些生成器將影像從領域A轉換為領域B,反之亦然。它們負責最小化原始影像和轉換影像之間的重建誤差。

判別器網路 (D_A 和 D_B)

CycleGAN有兩個判別器網路,例如D_A和D_B。這些判別器分別區分領域A和B中真實影像和轉換影像。它們負責使用對抗性損失來提高生成影像的真實性。

迴圈一致性損失

CycleGAN引入了第三個元件,稱為迴圈一致性損失。它強制執行領域A和B中真實影像和轉換影像之間的一致性。藉助迴圈一致性損失,生成器學習兩個領域之間有意義的對映,並確保生成影像的真實性。

下面是CycleGAN的示意圖:

CycleGAN的應用

CycleGAN應用於各種影像到影像的轉換任務,包括:

- 風格遷移 - CycleGAN可用於在不同領域之間轉移影像的風格。這包括將照片轉換為繪畫、日景轉換為夜景以及航拍照片轉換為地圖等。

- 領域自適應 - CycleGAN可用於將基於合成數據訓練的模型適應於真實世界資料。這提高了在各種任務(如目標檢測和語義分割)中的泛化能力和效能。

- 影像增強 - CycleGAN可用於透過去除偽影、調整顏色和改善視覺美感來增強影像質量。

什麼是StyleGAN?

StyleGAN,簡稱風格生成對抗網路,是由NVIDIA開發的一種GAN框架。StyleGAN專門設計用於生成逼真的高質量影像。

與傳統的GAN相比,StyleGAN引入了一些創新的技術來改進影像合成,並對特定屬性具有更好的控制。

StyleGAN的架構

StyleGAN使用傳統的漸進式GAN架構,並在其生成器部分進行了一些修改。判別器部分幾乎與傳統的漸進式GAN相同。讓我們瞭解StyleGAN架構的不同之處:

漸進式增長

與傳統的GAN相比,StyleGAN使用漸進式增長策略,在此策略的幫助下,生成器和判別器網路在訓練過程中逐漸增加大小和複雜性。這種漸進式增長允許StyleGAN生成更高解析度的影像(高達1024x1024畫素)。

對映網路

為了控制生成影像的風格和外觀,StyleGAN使用對映網路。這個對映網路將輸入潛在空間向量轉換為中間潛在向量。

合成網路

StyleGAN還包含一個合成網路,它接收對映網路生成的中間潛在向量並生成最終影像輸出。合成網路由一系列具有自適應例項歸一化的卷積層組成,使模型能夠生成具有細小細節的高質量影像。

風格混合正則化

StyleGAN還在訓練過程中引入了風格混合正則化,它允許模型組合來自多個潛在向量的不同風格。風格混合正則化的優點是它增強了生成輸出影像的真實性。

StyleGAN的應用

StyleGAN應用於各種領域,包括:

藝術渲染

由於對年齡、性別和麵部表情等特定屬性具有更好的控制,StyleGAN可用於建立逼真的肖像、藝術作品和其他型別的影像。

時尚與設計

StyleGAN可用於生成各種服裝設計、紋理和風格。此功能使StyleGAN成為時尚設計和虛擬試穿應用中的寶貴模型。

面部變形

StyleGAN為我們提供了不同面部屬性之間平滑變形的可能性。此功能使StyleGAN可用於年齡預測、性別轉換和麵部表情轉移等應用。

結論

本章解釋了傳統生成對抗網路的兩個不同變體,即CycleGAN和StyleGAN。

CycleGAN設計用於非配對影像到影像的轉換任務,其中輸入和輸出影像之間沒有關係,而StyleGAN專門設計用於生成逼真的高質量影像。

瞭解CycleGAN和StyleGAN背後的架構和創新,使我們能夠深入瞭解它們建立逼真輸出影像的潛力。