XGBoost - 歷史與架構

XGBoost,或極端梯度提升,是一種使用梯度提升框架的機器學習方法。它提供諸如正則化以防止過擬合、缺失資料管理以及允許使用者定義自己的最佳化目標和標準的可定製方法等功能。

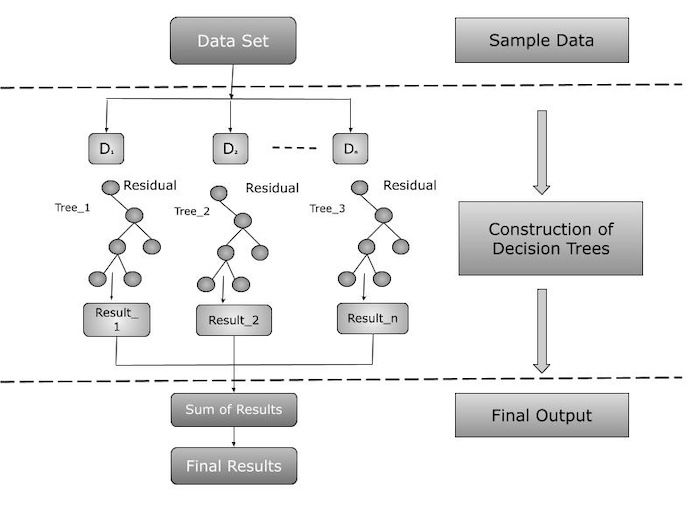

XGBoost 的架構

XGBoost 的架構以其可擴充套件且高效的梯度提升決策樹實現而脫穎而出。它包括諸如正則化以防止過擬合、缺失資料管理以及允許使用者建立自己的最佳化目標和標準的可定製方法等功能。這些功能有助於提高預測模型的穩健性和準確性。

其架構大致可以分為兩個主要組成部分:

順序學習

XGBoost 通常使用決策樹作為其基礎學習。每個後續樹都是建立在上一個樹的錯誤之上的,重點關注被錯誤分類的資料點。該方法使用梯度下降來查詢每棵樹的最佳權重,同時最小化損失函式。

整合

XGBoost 生成一個決策樹整合,並結合它們的預測以提高整體準確性。最終預測是所有樹預測的加權和,並根據效能進行加權。

XGBoost 架構的關鍵特性

XGBoost 架構顯示其主要元件和互連。以下是架構特性的概述:

正則化:XGBoost 使用正則化技術來避免過擬合。

並行處理:它採用並行處理來加速訓練。

靈活:它可以處理迴歸和分類問題。

高效能:XGBoost 在各種機器學習競賽中 consistently 表現出色。

XGBoost 學習型別

XGBoost 主要依賴於監督學習,這涉及從標記資料中學習。此方法需要在同時具有輸入特徵和輸出標籤的資料集上構建模型。此訓練幫助模型理解輸入和輸出之間的關係,從而允許它根據以前未知的資料進行預測或分類。

XGBoost 擅長處理結構化資料,通常用於迴歸(預測連續值)和分類(預測離散標籤)。

XGBoost 演算法方法

XGBoost 的演算法基礎基於基於樹的技術,主要是梯度提升。梯度提升是一種整合技術,它按順序建立多個決策樹,每棵樹都試圖糾正前面樹的任何弱點。這從大量弱學習器中建立了一個強學習器,從而提高了模型的整體準確性和穩健性。

XGBoost 以將其正則化技術結合到其梯度提升框架中而聞名。正則化(L1 和 L2)用於防止過擬合併提高模型對新資料的適應性。此外,XGBoost 在樹構建過程中最佳化損失函式,這對於迴歸和分類任務中的有效學習至關重要。

XGBoost 在許多型別的機器學習應用程式中的有效性和普及性可以歸因於其監督學習和複雜的基於樹的梯度提升策略的結合,並透過正則化方法得到增強。

總結

XGBoost 是一種強大的機器學習演算法,它透過生成和組合多個決策樹來改進預測。它在 2010 年代中期贏得了多次競賽後而流行起來。XGBoost 適用於結構化資料,可以解決迴歸和分類問題,並使用正則化方法來避免過擬合。