基於訓練集大小選擇分類器

為了使機器學習模型達到最佳效能,選擇正確的分類器演算法至關重要。由於可用的方法範圍很廣,選擇最佳分類演算法可能具有挑戰性。在選擇演算法時,必須考慮一系列因素,因為不同的演算法對不同型別的資料效果更好。其中一個因素是訓練資料的數量。大型訓練資料集會對分類系統的效能產生重大影響。

分類器的效能通常會隨著訓練資料集大小的增加而提高。但這並非總是如此,因為某些分類器在訓練集較少的情況下可能表現更好。為特定用例選擇最佳方法需要了解各種分類器如何在各種資料大小下執行。在本篇文章中,我們將討論一些最流行的機器學習分類器以及訓練集大小如何影響它們的效能。

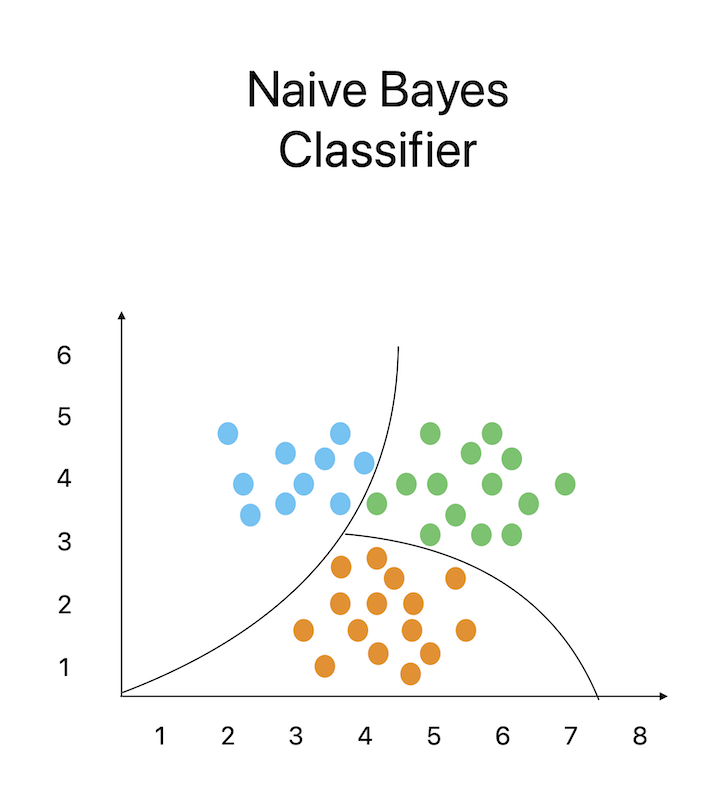

1. 樸素貝葉斯分類器

樸素貝葉斯是一種眾所周知的分類技術,它透過應用貝葉斯定理來確定資料點是否屬於某個特定類別。它基於這樣的假設:一個特徵包含在某個類別中的可能性與任何其他特徵包含在該類別中的可能性無關。由於獨立性假設,該方法可以有效地確定給定類別下每個特徵的機率,將這些機率相乘,然後得到給定資料下類別的機率。

樸素貝葉斯特別適用於文字分類任務,例如垃圾郵件過濾和情感分析,在這種情況下,資料稀疏且特徵數量眾多。因為它即使在缺乏足夠資料的情況下,仍然可以對類別和屬性之間的關係做出可靠的預測,所以它特別適合小型訓練集。就效能而言,樸素貝葉斯在小型訓練集上可能非常有效,並且可以用最少的資料產生可靠的結果。一些樸素貝葉斯的應用包括文件分類、情感分析和電子郵件垃圾郵件篩選。

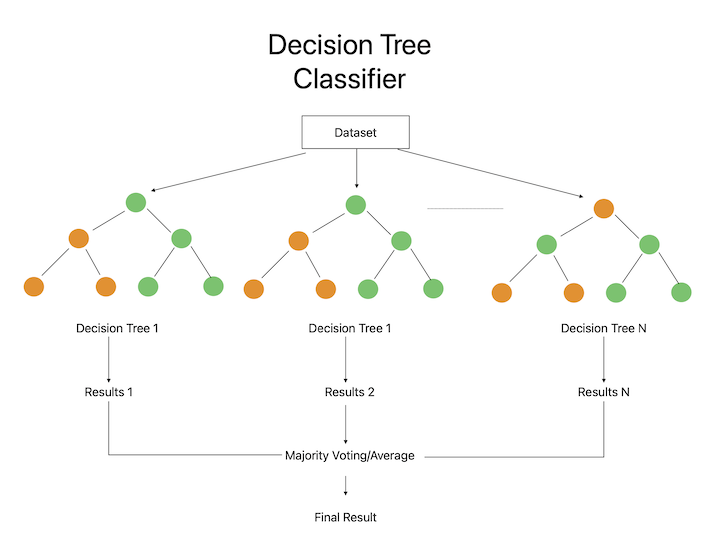

2. 決策樹分類器

決策樹是一種常見的分類方法,它使用節點的層次結構來表示決策及其結果。該演算法從表示整個資料集的根節點開始,根據輸入屬性的值進行一系列決策,將資料劃分為關於目標變數更同質的子集。當演算法到達表示最終預測類別的樹葉時,分割過程完成。

決策樹尤其適用於資料中特徵較少的情況,因為它可以快速識別最重要的特徵及其與目標變數的關係。它們也可以在最小訓練集上表現良好,因為它們可以找到簡單的決策規則,這些規則擅長泛化到新資料。然而,當處理包含大量特徵的複雜資料集時,它們可能會容易過擬合。決策樹的一些應用包括信用風險分析、客戶細分和醫療診斷。

3. 隨機森林分類器

眾所周知的分類方法隨機森林結合了許多決策樹。該方法透過使用輸入特徵和訓練資料的隨機子集來構建大量決策樹。然後,使用所有樹的預測的總和來建立最終預測。

隨機森林尤其適用於資料包含大量特徵的情況,因為它可以識別最重要的特徵並捕獲屬性與目標變數之間的非線性關係。它也可以在大型訓練集上表現良好,因為它可以容忍缺失值和噪聲資料,並且可以擴充套件到高維資料。隨機森林的一些應用包括生成推薦系統、影像分類和欺詐檢測。

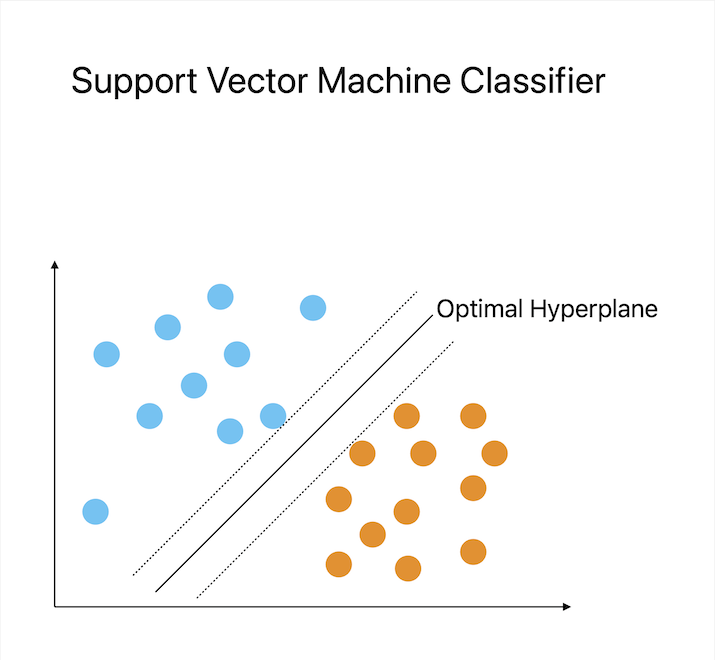

4. 支援向量機分類器

一種流行的分類技術,支援向量機 (SVM) 找到最佳化類別之間距離的超平面來對資料進行分類。在二元分類任務中,超平面表示將兩個類別分開的決策邊界。該方法透過將輸入資料投影到高維空間來工作,在該空間中,線性分類器可以找到超平面。

SVM 非常適用於類別區分清晰且資料包含中等至大量特徵的任務。因為它可以識別最重要的特徵並忽略不重要的特徵,所以它也可以在從小型到大型的訓練集上表現良好。透過應用核函式,SVM 也擅長處理特徵與目標變數之間的非線性關係。SVM 的一些應用案例包括影像分類、文字分類和生物資訊學。

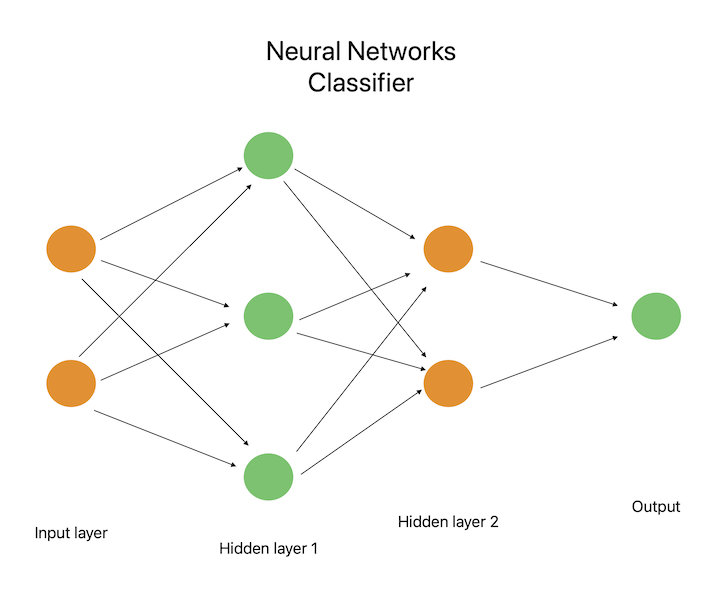

5. 神經網路分類器

神經網路是受人腦結構和功能啟發的機器學習演算法。神經網路由許多相互連線的節點(也稱為神經元)組成,這些節點排列成層。第一層節點處理輸入資料,然後繼續處理前一層節點的輸出,依此類推,最後一層產生網路的輸出。在訓練過程中,使用反向傳播等最佳化方法來學習節點之間連線的權重和偏差。

對於需要複雜和多維輸入的應用,例如語音和影像識別,神經網路非常有用。它們也擅長處理大型訓練集,因為它們可以從大量資料中學習並識別特徵與目標變數之間複雜的非線性關係。神經網路的一些應用包括自然語言處理、語音識別、自動駕駛和影像分類。

結論

總之,訓練集的大小會顯著影響分類器系統的效能。大型訓練集可以提高泛化能力和準確性,而較大的訓練集可以防止過擬合和泛化能力差。但是,某些演算法可能在較小或較大的訓練集上效果更好,具體取決於它們與之一起使用的資料型別。為了找到特定任務的最佳設定,務必嘗試各種演算法和訓練集大小。

資料結構

資料結構 網路

網路 關係型資料庫管理系統 (RDBMS)

關係型資料庫管理系統 (RDBMS) 作業系統

作業系統 Java

Java iOS

iOS HTML

HTML CSS

CSS Android

Android Python

Python C語言程式設計

C語言程式設計 C++

C++ C#

C# MongoDB

MongoDB MySQL

MySQL Javascript

Javascript PHP

PHP